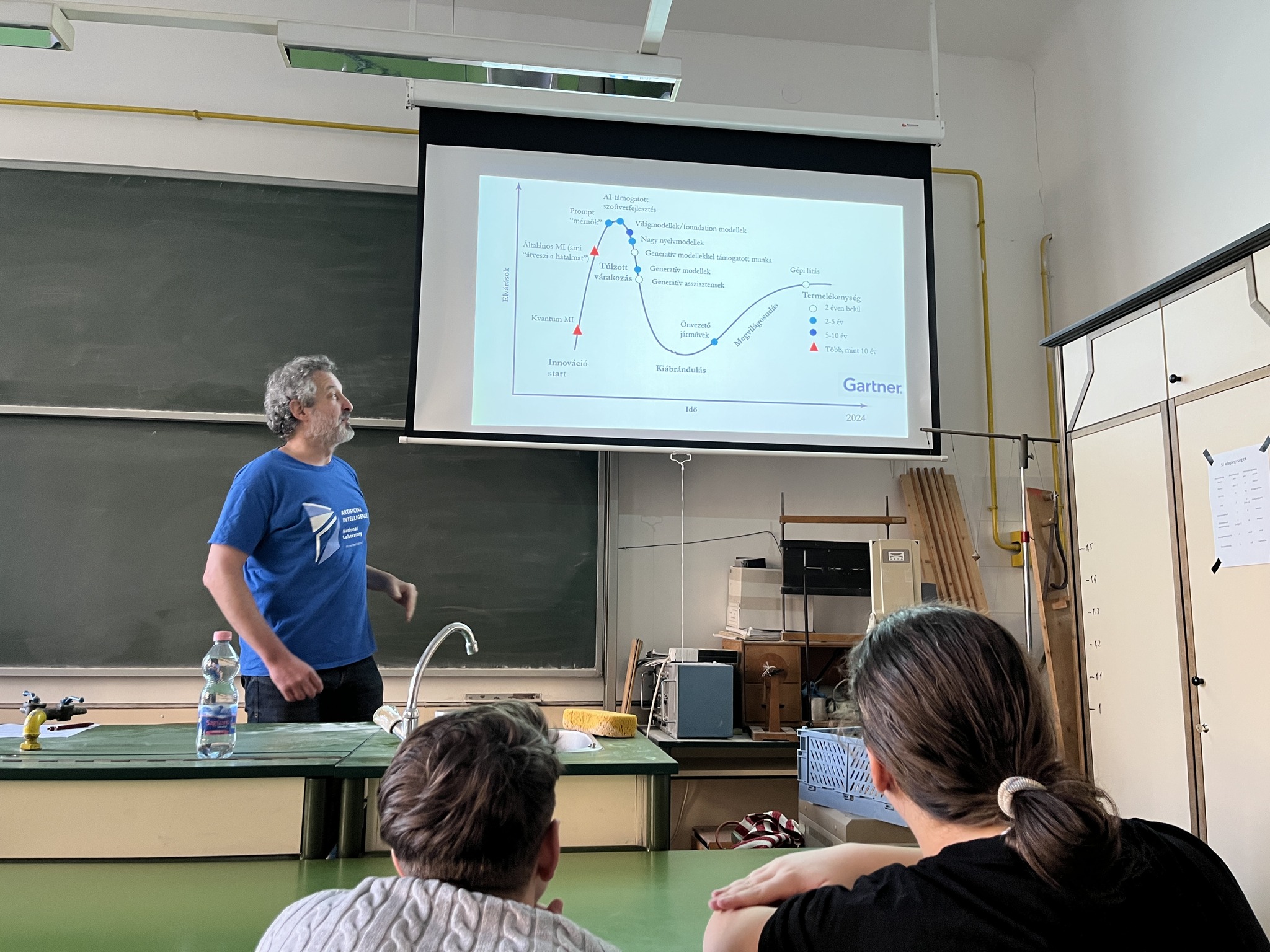

Benczúr András, a Mesterséges Intelligencia Nemzeti Laboratórium matematikusa 1987-ben végzett a Fazekasban, néhány évente visszatér előadást tartani. Ezúttal bemelegítésként felvázolta az MI-re (is) vonatkozó tipikus fejlesztési útvonalat, amely nagyjából az innováció start – túlzott várakozás – kiábrándulás – megvilágosodás – termelékenység állomásokkal írható le.

És akkor innen tényleg csak címszavakban erről a rendkívül komplex témáról: szó esett az idegsejtek mintájára Rosenblatt által épített neuronhálóról; a logisztikus regresszióról; a síkkal el nem vágható problémákat megoldó többrétegű hálókról; konvolúcióról; mintavételezésről; mélytanulásról; rekurrens hálókról.

Az előadás második felében részletesebben beszélt a mély hálók súlyainak tanításáról gradiens módszerrel; a ReLU, Dropout, Batch normalization kombinált használatának köszönhető áttörésről; szavak beágyazásáról a vektortérbe (a Chat GPT kezdeti modelljeinek működési logikája).

Végül áttekintést adott azokról a területekről, ahol a gépi tanulás forradalmasít(hat)ja a mindennapokat, mint például a robotika, a távközlés vagy az egészségügy, illetve öregedés-kutatás vagy a gyártás (például autó).